财联社6月1日讯(记者 徐赐豪)ChatGPT问世后,各大公司争相开发大模型,但作为老牌科技公司的戴尔似乎没有太多动静。

(资料图片)

(资料图片)

本期《元宇宙之约》对话了戴尔科技集团中国研究院首席科学家李三平。据李三平透露,戴尔对自己的定位是核心基础架构公司,通用大模型不是戴尔的首选,而是打造支撑数据密集、计算密集型人工智能应用的高性能算力平台,同时基于企业内部的知识库打造面向业务的语言模型。

现在越来越多公司创建大模型,李三平认为能否成功的关键是“是否拥有构造高质量数据集的能力”。

大模型越来越强大后能否从技术的角度来规范管理大模型?李三平表示,技术算法上可以用强化学习让大模型与人类对齐。

通用大模型不是戴尔的首选

目前还没有看到戴尔发布自己的大模型,据您了解戴尔在大模型上持什么态度?

李三平:戴尔对自己的定位就是核心基础架构公司。其实,我们有做大语言模型方面的研发工作:一是提供计算平台来支撑大语言模型;二是戴尔会把机器学习或者人工智能技术用在自己的产品、服务和内部工作流程当中,比如用于优化产品性能或者优化客户服务。

戴尔有像其他科技公司一样开发通用大模型的计划吗?

李三平:现在大家都关注的通用大模型肯定不是戴尔的首选,像我们正在做的还是结合企业内部自己的知识库打造面向自己业务的语言模型。

ChatGPT的成功,对您会有什么启发?

李三平:概率这种数学工具其实是对物理世界的一种近似表达或者近似建模。因为我们不可能获得对整个物理世界的完整信息,所以基于我们所获得的局部信息来进行一种近似建模。

现在语言模型利用这样的一些数学方法也能在自然语言理解上表现超出普通人的能力。说明概率建模能力超出了我们之前对它的理解。

也就是说,通过单纯计算的方式我们也有能力表达对物理世界的理解。所以说语言模型就是一种智能发展形式。

高质量的数据集是构建好大模型的基础

有人将互联网、智能手机以及ChatGPT视作三次技术浪潮,怎么判断大模型是真正的技术浪潮而不是伪浪潮?

李三平:现在还不太好判断大模型是真的浪潮还是假的浪潮,毕竟它是一个新兴技术,初期大家肯定是对它期许特别高,媒体或者市场肯定会有过度炒作。我们其实要关心的是,这一轮泡沫之后,这个技术还剩下多少,是不是还在继续扎扎实实的前进,还是说消失了。所以,我们需要时间来判断真伪。

其实就像之前的互联网、智能手机,也是经过了若干年的发展,逐渐成熟到大家接受的技术突破。甚至人们慢慢的就会认为,这是理所当然的,不再把它们认为是一种新兴技术。这个时候也意味着,这个技术已经完全成熟进入到了我们的工作和生活中。

现在对大语言模型来说,它也需要这样一个发展过程。

ChatGPT引发了新一轮的科技互联网竞赛,哪些是真正的在做事,哪些是炒作呢?

李三平:从技术方向来说,目前大模型大家都在探索当中。说难听一点,大部分技术探索最后探索着也就没了。因为那个方向可能并不具备什么实际的意义或者这个问题本身并没有那么大的价值。

国内现在很多的科技公司宣称要做大模型,但根本闭口不谈实实在在的细节问题,而只说我把大模型做到多好,确实有炒作嫌疑。

数据的数量现在不是一个特别难的问题,因为在互联网环境下,我们能搜集到非常多语料,而且也有很多机构一直主动构建各种各样的语料库。但数据质量始终是一个难题。

我们如何通过技术方法获得高质量的数据集,这是最根本的基础。如果没有这个就不可能做出高性能的大语言模型。

数据质量这个事情可能创新的东西不会太多,更多的是工程性的投入,你要是没有足够时间和人力投入,确实很难去解决。

与人类对齐训练让大模型符合人的预期

ChatGPT出现后,很多知名企业家、人工智能领域的专家都说这是一场变革,您觉得它的出现对人工智能产业意味着什么?

李三平:大家都普遍认同的一个观点是,ChatGPT它属于一种人机交互方式的变革,或者说人与技术交互方式的变革。

直接影响改变的是人类获取信息的方式,给我们提供了能够快速获取跨领域知识的能力。那么我们个体能走多快、能走多远,还是取决于自己的学习能力。

我觉得从技术角度来说,ChatGPT肯定会鼓励整个社区继续沿着大模型的路径,就是利用大规模算法、基于海量的多元化数据,然后通过机器自我学习的方式从数据中挖掘有价值的信息,从而产生更大的智能涌现。

未来的话存在更多不确定性。但是我们如果沿着这种大模型路径继续往前走,模型的性能越来越强随即而来的就是对人工智能的监管。因为大模型的能力会引起很多担忧,说明这种技术本身确实有实力去造出更强大的东西,有可能被用来做好事情,也有可能被用来做不好的事情。

这种担忧我们是否能从技术角度去规范它,让GPT或者聊天机器人能符合人类的预期,避免失控?

李三平:大语言模型对语言的理解能力甚至可以超越人类,那么我们怎么能让它表述的答案符合人类的一些价值观,其实从技术的角度有一个专有名词——与人类对齐,就是说去对齐人类的价值观。

大语言模型有时候会生成一些人类根本不会使用的表达方式,并不符合我们的一个期望。其实,OpenAI花了非常多人力和时间在做和人类对齐、和人类的期望对齐的事情。

技术算法上的解决方法就是强化学习,让模型去主动构建很多人类期望的表达方式。比如设置一些问题,让人类回答,也让模型回答,最后人类来评分,让大模型去强化学习那些评分高的答案,去学习人类的表达标准。可能语言模型仍然会产生很多答案,我们可以用强化学习过滤掉那些不符合人类期望的答案。

检察官担任法治副校长有了“指挥棒”

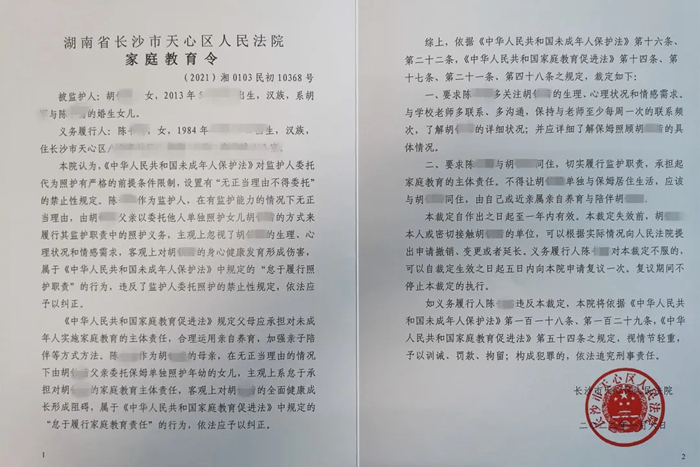

检察官担任法治副校长有了“指挥棒” 全国首份《家庭教育令》来了!督促家长“依法带娃”

全国首份《家庭教育令》来了!督促家长“依法带娃” 俄军装甲车辆将具备隐身能力

俄军装甲车辆将具备隐身能力